ChainerRLとOpenAI Gymで強化学習シミュレーション

ChainerRLとOpenAI Gymで強化学習シミュレーション

ChainerRLとOpenAI Gymで強化学習シミュレーション

先日、DockerでChainerの開発環境を作り、公式サイトのChainerCVのサンプル実行や有志の方のスクリプトのデモをしてみました。

続いて公式アドオンChainerMN/ChainerRLの何れかのサンプルを、と思い、どちらかと言えば、ChainerRLの方がとっつきやすそうということで公式ドキュメントからリンクのあったOpenAI GymのサンプルをJupyter Notebookで実行してみました。

ChainerRLは、Deep Reinforcement Learning Library/深層強化学習ライブラリ、OpenAI Gymは、ゲーム風のサンプルを多く含む強化学習(Reinforcement Learning)シミュレーションのツールキットです。

Pythonは3系(Python 3.6.6)を使いますが、自動で入った模様の2系は、2.7.15rc1です。

ちなみに今回、検証に使っているパソコンのGPUは、Intel HD Graphics 510というオンボードのもので主流らしきNVIDIA製ではないのでCPUで動かしてみている一方、Intel CPU アクセラレータiDeepは、まだ、試していません。

DockerとDockerfile

少なくとも現時点では、UbuntuやCentOSならEE/Enterprise版も使えるようですが、DebianやFedoraはCE版のみ、RHLに触れたり、Fedoraを使っていたこともある自身もOSを乗り換えるほどの熱量はなく、DebianにCE版をインストールしました。

CE版のインストールは、OS、プラットフォームごとに詳述されているので戸惑うこともありませんでした。

OpenAI Gymに倣い、インストールします。

ここでは、冒頭の開発環境においてgymも既にインストール済みなので、その次からということでcat /etc/os-releaseによれば、Ubuntuのバージョンは、18.04なので、このバージョンに必要なパッケージをインストール、敢えてapt-installのRUN行を分けてみました。

これまでpython3パッケージをインストールしていましたが、これを見るとpython3-devを入れたほうが良いようですね。

Dockerコンテナ(仮想OS)を起動しますが、こられが何をしているのかについて必要であれば、冒頭のChainer開発環境のリンク先を参照ください。

ホストはDebian(Linux)であり、GUIは、Dockerfileでの設定に加え、docker run前のxhostコマンド実行やdocker run時の-vオプション指定で起動可能なように設定してあることで起動するので、あとは試してみるだけです。

最初、端末でpython3として実行し、サンプルがことごとくTrueで終わってしまい、おや?と思い、あ、こんな時こそ、Jupyter...、いやいや、Jupyterを開くまでもなかったと気づいた次第。

当然でしょうが、ChainerRL Quickstart GuideのIn [1]〜IN [11]までを端末上でpython3とやって、全てコピペしていったところ、そのページの結果通りになりました。

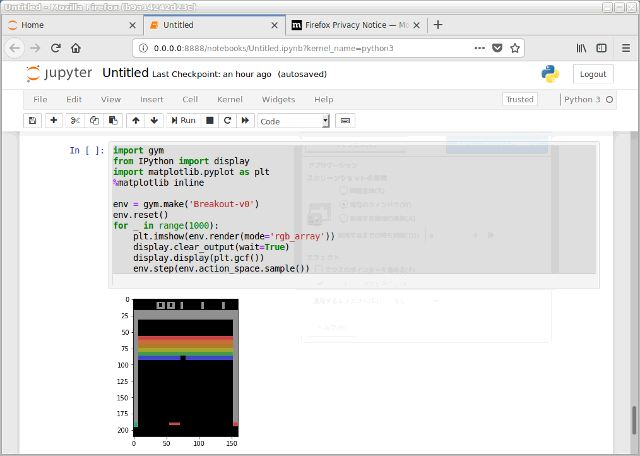

jaimeps/docker-rl-gymのサンプルを実行するとブラウザの同一画面上(canvas)でブロック崩しが始まりました。

続いてインストール時のチュートリアルにあったサンプルを試してみたところ、追加で環境整備が必要そうなMujocoとRoboticsと結果がテキストであるToy text以外は、相応のポップアップが表示されました。

ただ、どれも静止画なのですが、これはこれでよいのかな...jaimeps/docker-rl-gymのサンプルのように書けば、動くんですかね?

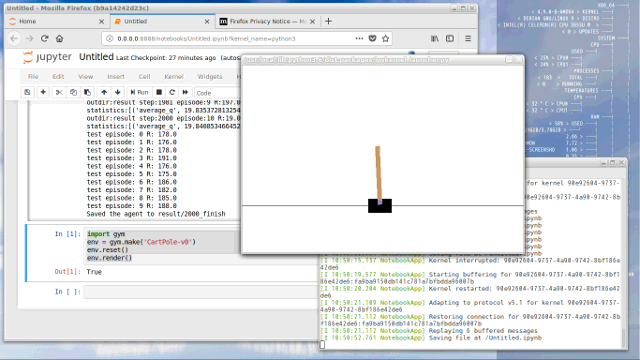

そのうちの1つ、CartPole-v0のサンプルが、これです。

と思ったら、Jupyter Notebookを開くまでもなく、openai/gymをgit cloneしてexamples/agents/に移動、cem.pyやrandom_agent.pyを実行したところ、ポップアップ画面上で先のCartPole-v0サンプルが、keyboard_agent.pyを実行すると別のサンプルが動きました。

github

openai/gymを始めとする公式ライブラリをDockerコンテナ内でgit cloneすることで、その中の各種サンプル(examples)もいろいろ実行確認してみています。

ライブラリをgit cloneし始めるとキリがないのでDockerfileには、書かず、ホスト側に置いてdocker run時に-vオプションでマウントしています。

関連リンク

- AI/人工知能

- AI開発環境

- DockerでTensorFlow/Keras開発環境を作る

- DockerでChainer開発環境を作る

- ChainerCV/YoloとWebカメラでリアルタイム物体検出デモ

- ChainerCV Object Detection/対象検出サンプルの実行

- ChainerRLとOpenAI Gymで強化学習シミュレーション

- DockerでPyTorch開発環境を作る

- AIに触れてみる

- AMD Ryzen AIソフトウェアのインストールから始まるRyzen AI

- AMD Ryzen/RadeonチューニングアプリAMD Software

- CPU/GPU/iGPU/NPUを可視化する on Linux Ryzen 7 8845HS

- amd / RyzenAI-SW TutorialでAI学習

- 自然言語処理

- 自然言語処理ライブラリspaCy

- 形態素解析

- 構文解析/係り受け解析

- 自然言語処理モデル

- 自然言語処理モデルGPT

- 自然言語処理モデルGPT-3を使う

- OpenAI GPT-3のExamplesを試してみた

- OpenAI GPT-3のExamples/Chatを試してみた

- OpenAI GPT-3のExamples/Grammar correctionを試してみた

- OpenAI GPT-3のExamples/Natural language to OpenAI APIを試してみた

- OpenAI GPT-3のExamples/English to Frenchを試してみた

- OpenAI GPT-3のExamples/SQL translateを試してみた

- OpenAI GPT-3のExamples/Classificationを試してみた

- OpenAI GPT-3のExamples/Movie to Emojiを試してみた

- OpenAI GPT-3のExamples/Translate programming languagesを試してみた

- OpenAI GPT-3のExamples/Explain codeを試してみた

- OpenAI GPT-3のExamples/Factual answeringを試してみた

- OpenAI GPT-3のExamples/Product name generatorを試してみた

- OpenAI GPT-3のExamples/Python bug fixerを試してみた

- OpenAI GPT-3のExamples/JavaScript helper chatbotを試してみた

- OpenAI GPT-3のExamples/Science fiction book list makerを試してみた

- OpenAI GPT-3のExamples/Airport code extractorを試してみた

- OpenAI GPT-3のExamples/Extract contact informationを試してみた

- OpenAI GPT-3のExamples/Friend chatを試してみた

- OpenAI GPT-3のExamples/Write a Python docstringを試してみた

- OpenAI GPT-3のExamples/JavaScript one line functionを試してみた

- OpenAI GPT-3のExamples/Third-person converterを試してみた

- OpenAI GPT-3のExamples/VR fitness idea generatorを試してみた

- OpenAI GPT-3のExamples/Essay outlineを試してみた

- OpenAI GPT-3のExamples/Marv the sarcastic chat botを試してみた

- OpenAI GPT-3のExamples/Restaurant review creatorを試してみた

- OpenAI GPT-3のExamples/Interview questionsを試してみた

- OpenAI GPT-3のExamples/Q&Aを試してみた

- OpenAI GPT-3のExamples/Summarize for a 2nd graderを試してみた

- OpenAI GPT-3のExamples/Text to commandを試してみた

- OpenAI GPT-3のExamples/Natural language to Stripe APIを試してみた

- OpenAI GPT-3のExamples/Parse unstructured dataを試してみた

- OpenAI GPT-3のExamples/Python to natural languageを試してみた

- OpenAI GPT-3のExamples/Calculate Time Complexityを試してみた

- OpenAI GPT-3のExamples/Advanced tweet classifierを試してみた

- OpenAI GPT-3のExamples/Keywordsを試してみた

- OpenAI GPT-3のExamples/Ad from product descriptionを試してみた

- OpenAI GPT-3のExamples/TL;DR summarizationを試してみた

- OpenAI GPT-3のExamples/Spreadsheet generatorを試してみた

- OpenAI GPT-3のExamples/ML/AI language model tutorを試してみた

- OpenAI GPT-3のExamples/Tweet classifierを試してみた

- OpenAI GPT-3のExamples/SQL requestを試してみた

- OpenAI GPT-3のExamples/JavaScript to Pythonを試してみた

- OpenAI GPT-3のExamples/Mood to colorを試してみた

- OpenAI GPT-3のExamples/Analogy makerを試してみた

- OpenAI GPT-3のExamples/Micro horror story creatorを試してみた

- OpenAI GPT-3のExamples/Notes to summaryを試してみた

- OpenAI GPT-3のExamples/ESRB ratingを試してみた

- OpenAI GPT-3のExamples/Recipe generatorを試してみた

- OpenAI GPT-3のExamples/Turn by turn directionsを試してみた

- OpenAI GPT-3のExamples/Create study notesを試してみた

- コンピュータービジョン

- OCR/光学文字認識

- 物体認識・動体検知

- 画像認識

- 音声認識/Speech Synthesis/Speech to Text

- 音声合成/Text to Speech

- 電子工作・IoT・スマートデバイス例

- AIアシスタント・AIチャットボット

- AIチャットボットCopilotをAMD Ryzen 7 8845HS AI PCで使う

- LM StudioでローカルAI on Linux/Windows Ryzen 7 8845HS

- Ollama/AlpacaとLLMでエッジAI on Linux Ryzen 7 8845HS

- ComfyUIやLocalAIでローカル生成AI on Linux Ryzen 7 8845HS

- 音声・画像・映像...etc.生成AI